С распространением технологий искусственного интеллекта мир столкнулся с новой, более опасной формой преступности. Речь идёт о стремительном росте материалов сексуальной эксплуатации детей, созданных с помощью ИИ.

По данным Internet Watch Foundation, только за первую половину 2025 года было выявлено 1 286 подобных видео. Для сравнения: за аналогичный период 2024 года — всего 2 случая. Таким образом, рост составил 643 раза.

Особую тревогу вызывает уровень жестокости: около 65% выявленных материалов относятся к наиболее тяжёлой категории, и по визуальной достоверности они практически неотличимы от реальных съёмок. При этом подобный контент распространяется не только в даркнете, но и в скрытых сегментах легальных платформ.

В Казахстан проблема усугубляется высоким уровнем цифровизации. Около 90% взрослого населения имеет доступ к интернету, а дети начинают пользоваться сетью уже с раннего возраста.

Согласно данным UNICEF:

- почти половина детей впервые выходит в интернет в возрасте 5–8 лет;

- ещё треть — в 9–12 лет;

- 92% несовершеннолетних ежедневно используют смартфоны;

- более половины проводят в сети свыше двух часов в день.

При этом более 3,3 млн детей активно пользуются интернетом, включая социальные сети, несмотря на возрастные ограничения. У значительной части несовершеннолетних аккаунты остаются открытыми, что повышает риски.

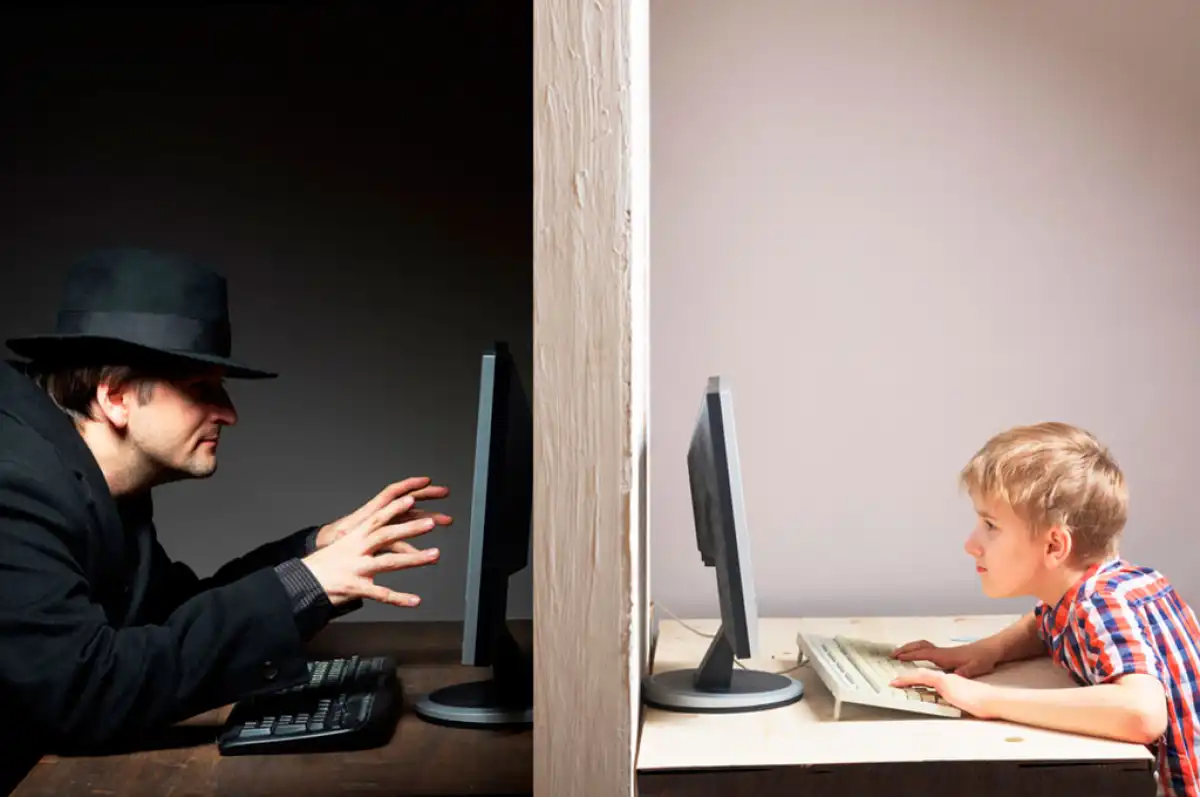

Исследования показывают, что проблема вредоносного контента носит системный характер. Каждый пятый ребёнок хотя бы раз в год сталкивается с сексуализированным контентом, а часть детей — регулярно. Среди наиболее распространённых ситуаций:

- навязчивые разговоры на интимные темы;

- сексуализированные комментарии;

- просьбы отправить личные фотографии;

- предложения денег или подарков;

- попытки шантажа.

Отдельную обеспокоенность вызывает то, что многие дети не сообщают о подобных случаях. Лишь небольшая часть обращается к взрослым, чаще подростки делятся переживаниями с друзьями или вовсе замалчивают проблему.

Как подчёркивают эксперты Интерпол и Thorn, угрозы всё чаще исходят не от незнакомцев, а от людей из ближайшего окружения — сверстников, знакомых или даже родственников.

Генеративные технологии делают ситуацию ещё сложнее. Сегодня злоумышленникам достаточно собрать несколько фотографий ребёнка из соцсетей, чтобы за короткое время создать реалистичные поддельные изображения или видео.

Международные исследования показывают: около 1,2 млн детей в разных странах уже сталкивались с манипуляциями их изображениями с помощью ИИ. В ряде государств фиксируется рост преступлений с участием самих подростков.

В Министерство внутренних дел Казахстана напоминают: подобные действия подпадают под уголовную ответственность. В частности, статья 311 УК РК предусматривает наказание за создание и распространение материалов сексуального насилия над детьми — независимо от того, были ли они созданы с помощью ИИ или нет.

Эксперты подчёркивают: в новых условиях ключевую роль играет цифровая грамотность родителей и своевременное внимание к онлайн-активности детей.